The article examines the current state and prospects for the development of self-learning systems in the context of information security. The architectural principles of building such systems are analyzed, their advantages and disadvantages are revealed.

Традиционные средства защиты информации (СЗИ), такие как межсетевые экраны и антивирусы, основаны на сигнатурном анализе и статических правилах. Они эффективно выявляют известные атаки, но их возможности ограничены в случае полиморфного вредоносного кода и целевых атак. В ответ на этот вызов возникло новое направление: применение методов машинного обучения (Machine Learning, ML) для создания самообучающихся систем защиты. Такие системы способны находить аномалии и адаптироваться к меняющейся среде без прямого участия человека.

Целью работы является анализ перспектив внедрения самообучающихся систем в контур безопасности корпоративных и государственных информационных систем, а также систематизация ограничений, препятствующих их повсеместному использованию.

Основы самообучающихся систем в области информационной безопасности.

Под самообучающейся системой защиты информации понимается программно-аппаратный комплекс, способный изменять свой алгоритм функционирования на основе анализа поступающих данных с сетевого трафика, действиях пользователей и системных событий. В основе таких систем лежат методы искусственного интеллекта.

Можно выделить три основных подхода к построению таких систем:

- Обучение с учителем (supervised learning). Модель обучается на размеченных наборах данных, где каждый образец классифицируется как «нормальный» или «вредоносный». Данный подход применяется для классификации трафика и обнаружения вредоносного ПО [1].

- Обучение без учителя (unsupervised learning). Модель анализирует немаркированные данные и самостоятельно выделяет аномалии (кластеры отклонений). Ключевой метод для обнаружения неизвестных атак (zero-day) [1].

- Обучение с подкреплением (reinforcement learning). Система взаимодействует со средой и учится на опыте, выбирая оптимальную стратегию реагирования на инцидент. Например, блокировка или изоляция узла [1].

Перспективы применения и преимущества.

Внедрение самообучающихся алгоритмов открывает качественно новые возможности для защиты информации.

- Обнаружение неизвестных угроз. В отличие от сигнатурного анализа, ML-модели могут выявлять вредоносную активность по последовательностям вызовов API, аномальной сетевой телеметрии, даже если сам вредоносный файл ранее не встречался. Исследования показывают, что применение рекуррентных нейронных сетей (RNN) позволяет значительно снизить долю ложных срабатываний при обнаружении шифровальщиков по сравнению с традиционными методами [2].

- Адаптивность. Полиморфные вирусы меняют свой код, но их поведение (паттерны) остается неизменным [3]. Самообучающаяся система, анализирующая поведенческие факторы, способна идентифицировать угрозу вне зависимости от ее синтаксической оболочки.

- Автоматизация реагирования. Система класса SOAR (Security Orchestration, Automation and Response), усиленные ML, могут не только детектировать инцидент, но и автоматически применять контрмеры, предоставляя аналитику уже готовый пакет данных для расследования [4].

Ограничения и уязвимости самообучающихся систем.

Несмотря на высокий потенциал, применение самообучающихся систем сопряжено с рядом ограничений, которые часто замалчиваются в маркетинговых материалах.

- Проблема качества данных. Эффективность модели напрямую зависит от полноты и репрезентативности обучающей выборки. Собрать выборку, включающую все виды легитимной активности и все возможные атаки, невозможно. Это приводит к проблеме дрейфа концепций, когда модель, обученная на данных годичной давности, перестает корректно работать в изменившейся инфраструктуре предприятия.

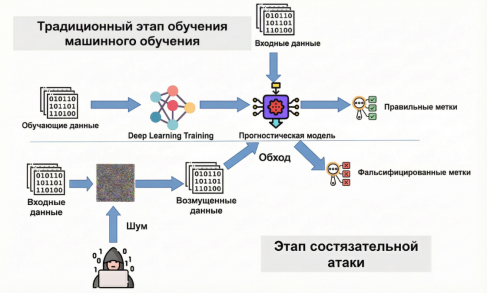

- Уязвимость к состязательным атакам. Специфическим ограничением для ML в ИБ является возможность обмана модели. Злоумышленники могут модифицировать вредоносное ПО таким образом, чтобы оно воспринималось классификатором как легитимное [5]. Например, внесение небольших возмущений в изображение (если речь идет о стеганографии) или в сетевой пакет может привести к ошибочной классификации с высоким процентом уверенности. Это называется состязательным машинным обучением.

Схема состязательной атаки представлена на рис. 1.

Рис. 1. Схема состязательной атаки

- Проблема интерпретируемости «Черный ящик». Большинство эффективных моделей являются неинтерпретируемыми. Специалист по ИБ получает лишь факт «Аномалия», но не может отследить логику принятия решения. В юридическом поле или при расследовании серьезных инцидентов отсутствие объяснений для блокировки тех или иных действий является критическим недостатком.

- Ресурсоемкость. Обучение и применение сложных моделей требует значительных вычислительных мощностей. Развертывание таких систем на периферийных устройствах (IoT) или в legacy-инфраструктуре затруднительно.

Заключение

Подводя итог, можно сказать, что самообучающиеся системы действительно меняют подход к защите информации. Машинное обучение позволяет замечать то, что человек или простая программа могут пропустить: необычное поведение программы, странные запросы в сети или действия, похожие на атаку.

Однако у таких систем есть и слабые места. Если злоумышленник знает как устроена нейросеть, он сможет обмануть ее, подменив данные. Также нельзя забывать, что алгоритмы часто работают как «черный ящик»: мы видим результат, но не всегда понимаем, почему система приняла то или иное решение. А для расследования инцидентов это очень важно.

Таким образом, оптимальный подход сегодня — не замена человека ИИ, а их совместная работа: алгоритмы берут на себя рутину и поиск аномалий, а специалист разбирается в сложных случаях. Дальнейшее развитие прозрачных и устойчивых к атакам моделей повысит доверие к системам и обеспечит их массовое внедрение.

Литература:

- Три метода обучения нейросетей: с учителем, без учителя, с подкреплением. — Текст: электронный // Yandex Practicum: [сайт]. — URL: https://practicum.yandex.ru/blog/mashinnoe-obuchenie-s-uchitelem-i-bez/ (дата обращения: 01.02.2026).

- Отрасли в фокусе: машинное обучение для обнаружения угроз кибербезопасности. — Текст: электронный // python-3.com: [сайт]. — URL: https://ru.python-3.com/?p=5460 (дата обращения: 01.03.2026).

- Полиморфный вирус. — Текст: электронный // sberbank.ru: [сайт]. — URL: https://www.sberbank.ru/ru/person/kibrary/vocabulary/polimorfnyj-virus (дата обращения: 01.03.2026).

- SOAR: Управление инцидентами кибербезопасности. — Текст: электронный // mosregdata.ru: [сайт]. — URL: https://mosregdata.ru/article/soar-security-orchestration-automation-response (дата обращения: 02.03.2026).

- Колесниченко, М. Д. Об уязвимости искусственных нейронных сетей к состязательным атакам / М. Д. Колесниченко. — Текст: непосредственный // Актуальные проблемы авиации и космонавтики. Сборник материалов VI Международной научно-практической конференции, посвященной Дню космонавтики. В 3-х томах. — Красноярск, 2020. — С. 228–229.