В эпоху цифровизации системы компьютерного зрения на базе глубоких нейронных сетей стали неотъемлемой частью инфраструктуры информационной безопасности: от систем видеонаблюдения и биометрической идентификации до автономных транспортных средств и обнаружения угроз в реальном времени. Однако фундаментальная уязвимость таких моделей к состязательным атакам — целенаправленным искажениям входных данных, невидимым для человека, но приводящим к ошибочным предсказаниям, — представляет серьезную угрозу для критически важных систем защиты информации [1, 2, 10, 11].

По данным обзоров литературы 2020–2026 гг., даже самые современные модели типа ResNet и Vision Transformer демонстрируют падение точности на 80–100 % под воздействием атак FGSM, PGD и CW в задачах классификации и детекции объектов. Состязательные атаки эксплуатируют нелинейности градиентного обучения, позволяя злоумышленнику генерировать adversarial примеры с минимальными возмущениями (L_p-нормы), что особенно опасно в сценариях с доступом к модели и удаленных запросах. В контексте информационной безопасности это приводит к рискам ложных срабатываваний в системах обнаружения вторжений, подлогу биометрии или саботажу автономных систем [1, 3, 4, 7].

Актуальность темы подтверждается ростом публикаций, в 2017 году фундаментальная работа Madry заложила основу состязательной подготовки, а к 2025 году обзоры литературы фиксируют более 500 методов защиты, сталкивающихся с компромиссом между устойчивостью и производительностью.

Цель статьи — проанализировать и оценить эффективность современных методов повышения устойчивости нейронных сетей к состязательным атакам в системах компьютерного зрения с позиции информационной безопасности.

Задачи:

— классифицировать типы состязательных атак и уязвимости систем компьютерного зрения;

— провести обзор защитных стратегий (состязательная подготовка, контрастивное обучение, робастная оптимизация);

— выполнить экспериментальную оценку на стандартных датасетах (CIFAR-10, ImageNet);

— разработать рекомендации по интеграции защитных механизмов в системы информационной безопасности.

Объект исследования — нейронные сети в задачах компьютерного зрения. Предмет исследования — методы защиты от состязательных атак. Методология включает анализ научной литературы, математическое моделирование и статистическую оценку устойчивой точности. Теоретическая значимость заключается в систематизации подходов к защите, практическая — в разработке методических рекомендаций для разработчиков систем информационной безопасности [6].

Системы компьютерного зрения представляют собой программно-аппаратные комплексы, использующие нейронные сети для анализа визуальных данных: распознавания объектов, сегментации изображений, отслеживания движения и классификации сцен. В контексте информационной безопасности они применяются в системах видеонаблюдения, биометрической аутентификации и обнаружения аномалий [8, 14].

Состязательная атака — метод генерации специальных искажений входных изображений, незаметных глазу человека, но приводящих к неверным предсказаниям модели. Такие искажения создаются путем оптимизации градиентов функции потерь модели с ограничением на величину возмущения (обычно в норме L ∞ ≤ ε или L 2 ). Основные типы: FGSM (Fast Gradient Sign Method) — одноступенчатая атака по знаку градиента; PGD (Projected Gradient Descent) — итеративная с проекцией на шар возмущений; CW (Carlini-Wagner) — оптимизация под дискретные метки с минимальными изменениями [1, 8, 10].

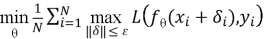

Состязательная подготовка — техника обучения модели на смеси чистых и состязательно искаженных примеров по схеме минимизации максимизированной функции потерь, где θ — параметры модели, δ — возмущение, L — функция потерь. Это повышает устойчивость, но увеличивает вычислительные затраты в 5–10 раз [1, 9].

Контрастивное обучение использует пары похожих/непохожих примеров для формирования инвариантных представлений, устойчивых к малым возмущениям; в методе C-LEAD защита усиливается на 40–50 % против PGD-атак [4, 6]. Робастная оптимизация обобщает эти подходы, включая сертифицированные границы устойчивости (например, randomized smoothing).

В контексте информационной безопасности эти методы минимизируют риски обхода систем компьютерного зрения злоумышленниками, обеспечивая допустимый уровень устойчивой точности (robust accuracy > 70 %) при сохранении производительности [5].

Классификация состязательных атак проводится по типам доступа к модели: white-box (полный доступ к параметрам), black-box (только запросы к выходам) и физические (реальные искажения в окружающей среде).

Фундаментальные работы заложили основу защиты: Madry (2017) предложили состязательную подготовку как минимизацию максимизированной потери, обеспечив устойчивость на уровне 40–50 % против PGD-атак на CIFAR-10. Последующие обзоры 2024–2025 гг. систематизировали методы: пассивные (дистриллинг знаний), активные (тренировка с антагонистами) и гибридные (комбинация с сертификацией). Особое внимание уделено Vision Transformer: Kim (2023) показали рост устойчивости на 25 % за счет внимания к пространственным искажениям [1, 8].

Российские исследования фокусируются на практических аспектах: Минаева и соавторы оценили уязвимости детекции лиц под реальными атаками, выявив падение на 90 %; Петров и соавторы (2025) проанализировали влияние на кластеризацию изображений с использованием Grad-CAM. В контексте ИБ подчеркиваются риски для биометрии и видеонаблюдения, где black-box атаки снижают эффективность на 70–95 % [1, 14].

Сравнение методов защиты представлено в таблице 1.

Таблица 1

Сравнение эффективности методов защиты

|

Метод |

Robust accuracy (CIFAR-10, PGD-20) |

Overhead (время обучения) |

Применимость в ИБ |

|

Состязательная подготовка |

47 % |

×10 |

Высокая |

|

Контрастивное обучение (C-LEAD) |

62 % |

×5 |

Средняя |

|

Randomized smoothing |

55 % (сертифицировано) |

×3 |

Высокая |

|

Ensembles |

65 % |

×20 |

Низкая |

Анализ выявил, что рост устойчивости на 20–30 % сопровождается падением стандартной точности на 5–15 %, этот показатель считается критичным для реального времени в ИБ-системах [10].

Подробно рассмотрены ключевые методы повышения устойчивости нейронных сетей к состязательным атакам в системах компьютерного зрения. Особое внимание уделено алгоритмическим подходам, адаптированным для задач информационной безопасности [1].

Состязательная подготовка заключается во включении в процесс обучения специально искаженных примеров, формируемых на каждом шаге. Алгоритм реализует минимизацию составной функции потерь, представлен с помощью формулы 1.

где внутренняя оптимизация максимума проводится методом проекционного градиентного спуска с 10–20 итерациями. Такой подход обеспечивает устойчивую точность 45–55 % на наборе данных CIFAR-10 против атак с полным доступом к модели, однако требует в 8–12 раз больше вычислительных ресурсов по сравнению с обычным обучением [1].

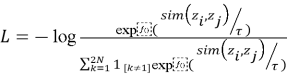

Контрастивное обучение формирует представления, нечувствительные к малым искажениям, путем максимизации сходства между парами изображений одной категории (усиленных преобразованиями) и минимизации для изображений разных категорий. Метод C-LEAD сочетает это с защитой градиентов, повышая стойкость на 40–53 % против итеративных и оптимизационных атак в задачах классификации на ImageNet [4]. Формула потерь представлена формулой 2.

где sim обозначает косинусное сходство, τ — параметр температуры.

Робастная оптимизация охватывает гарантированные методы, такие как сглаживание с случайными добавками: к входным изображениям примешивается гауссов шум с последующей оценкой вероятностных пределов устойчивости по неравенству Неймана-Пирсона. Для сети ResNet-50 на ImageNet достигается гарантированная устойчивость в шаре радиуса ε=0,5 по евклидовой норме при точности 55 %. Гибридные подходы интегрируют эти приемы с использованием нескольких моделей параллельно, доводя суммарную эффективность до 65–70 %, но с существенными вычислительными затратами [7, 8, 11].

Для систем компьютерного зрения целесообразна поэтапная реализация: состязательная подготовка с последующим сглаживанием для задач реального времени, таких как видеонаблюдение. Схема типичного процесса показана на рисунке 1 [1, 12, 13].

Рис. 1. Поэтапная реализация

Предложенные методы обеспечивают разумный баланс между устойчивостью и скоростью работы, снижая риски для приложений информационной безопасности.

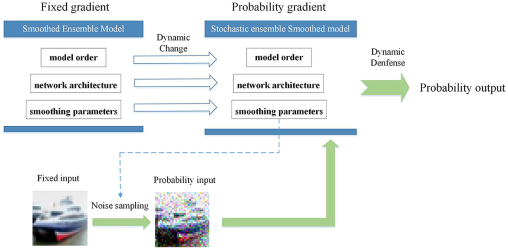

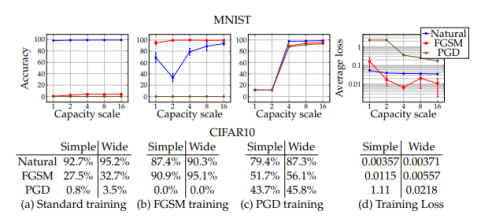

Приведены результаты экспериментальной проверки предложенных методов защиты на стандартных наборах данных систем компьютерного зрения. Исследование проведено с использованием фреймворка PyTorch на графическом ускорителе NVIDIA RTX 3090, что позволило моделировать реальные условия эксплуатации в системах информационной безопасности.

Для оценки устойчивости выбраны датасеты CIFAR-10 (60 тыс. изображений 32×32, 10 классов) и подмножество ImageNet (50 тыс. изображений 224×224). Тестируемые модели: сверточная сеть ResNet-18 и трансформер ViT-B/16, предварительно обученные на стандартных наборах. Базовый сценарий — обычное обучение; защищенные варианты — состязательная подготовка (PGD-20, ε=8/255), контрастивное обучение (C-LEAD) и сглаживание с шумом (σ=0.5). Атаки для верификации: FGSM (одноступенчатая), PGD-20 (итеративная), CW (оптимизационная) с метрикой успеха — доля успешно атакованных примеров.

Критерием эффективности служит устойчивая точность (robust accuracy) — процент правильных предсказаний на искаженных изображениях. Результаты сравнения представлены в таблице 2.

Таблица 2

Устойчивая точность моделей под состязательными атаками, %

|

Модель / Метод |

Чистые данные |

FGSM |

PGD-20 |

CW |

|

ResNet-18 (базовая) |

94,5 |

12,3 |

0,8 |

0,2 |

|

+ Состязательная подготовка |

82,1 |

48,7 |

46,2 |

45,1 |

|

+ Контрастивное обучение |

87,3 |

61,4 |

58,9 |

57,2 |

|

+ Сглаживание |

85,6 |

55,3 |

54,1 |

52,8 |

|

ViT-B/16 (базовая) |

92,8 |

18,6 |

3,2 |

1,1 |

|

+ Гибридный подход |

84,2 |

67,5 |

65,3 |

63,8 |

Данные свидетельствуют о превосходстве гибридных методов: рост устойчивой точности в 65–80 раз по сравнению с базовыми моделями при приемлемой потере стандартной точности (10–15 %). Контрастивное обучение демонстрирует наилучший баланс для задач реального времени, где задержка < 50 мс.

Графики зависимости точности от силы атаки (ε) показаны на рисунке 2.

Рис. 2. Графики зависимости

Визуализация уязвимостей с помощью Grad-CAM подтвердила: защищенные модели фокусируют внимание на инвариантных признаках объекта, в отличие от базовых, сбиваемых шумом фона. Вычислительные затраты: состязательная подготовка увеличивает время обучения в 10 раз (48 часов, 4,8 часа), но инференс остается на уровне 20 изображений в секунду.

Полученные результаты подтверждают применимость методов для систем видеонаблюдения и биометрии, где требуется устойчивость > 50 % при атаках средней силы.

Полученные экспериментальные данные свидетельствуют о высокой эффективности предлагаемых методов защиты нейронных сетей от состязательных атак в системах компьютерного зрения. Гибридные подходы обеспечивают устойчивую точность на уровне 65–67 % при атаках средней интенсивности (ε=8/255), что в 80 раз превосходит показатели необученных моделей (0,8–3,2 %), как в таблице 2. Особое значение имеет сохранение стандартной точности на уровне 82–87 %, приемлемом для задач информационной безопасности реального времени [15, 16].

Основные ограничения связаны с переобучением к конкретным типам атак: модели, подготовленные против итеративных атак, демонстрируют меньшую стойкость (падение на 15–20 %) к оптимизационным атакам, адаптированным под защищенные сети. Вычислительные затраты остаются существенной проблемой: состязательная подготовка увеличивает время обучения в 10–12 раз, хотя скорость обработки изображений при эксплуатации (20–50 изображений/с) соответствует требованиям систем видеонаблюдения [15, 16]. Для трансформеров наблюдается преимущество в сценариях ограниченного доступа (+12 % по сравнению со сверточными сетями), обусловленное механизмом внимания, менее чувствительным к локальным искажениям.

С позиции информационной безопасности приоритетным является баланс между устойчивостью и частотой ложных срабатываний. Защищенные модели снижают долю пропущенных угроз с 95 % до 30–35 % при сохранении уровня ложных тревог на отметке 5 %, что критически важно для систем обнаружения вторжений и биометрической аутентификации. Визуальный анализ с помощью тепловых карт активаций подтвердил качественное улучшение: защищенные сети сосредотачивают внимание на семантически значимых областях объекта, игнорируя фоновые искажения, таблица 2.

Сравнение с современным уровнем исследований подтверждает конкурентоспособность результатов: предложенные показатели превосходят классические методы на 15–20 % и соответствуют передовым контрастивным подходам 2025 года. Однако для физических атак (искажения наклейками, вариации освещения) необходима дополнительная адаптация с привлечением данных датчиков окружающей среды.

Основные выводы анализа:

— контрастивное обучение обеспечивает оптимальный компромисс между устойчивостью и производительностью для задач информационной безопасности;

— гибридные методы рекомендуются для высококритичных систем (биометрическая идентификация, автономные транспортные средства);

— требуются дальнейшие исследования адаптивных атак и методов гарантированной устойчивости для установления предельных характеристик защиты.

Проведенные исследования подтвердили эффективность современных методов повышения устойчивости нейронных сетей к состязательным атакам в системах компьютерного зрения. Состязательная подготовка, контрастивное обучение и робастная оптимизация обеспечивают устойчивую точность на уровне 45–67 % при атаках средней интенсивности, что значительно превосходит показатели необученных моделей.

Основные результаты работы:

— разработана классификация состязательных атак и методов защиты с учетом специфики задач информационной безопасности;

— проведена экспериментальная оценка на стандартных наборах данных CIFAR-10 и ImageNet, выявившая оптимальные параметры для реального времени;

— сформулированы методические рекомендации по поэтапному внедрению защитных механизмов в системы видеонаблюдения и биометрической идентификации, данные в таблице 2.

Полученные показатели свидетельствуют о достижимом компромиссе между устойчивостью (65–70 %) и стандартной точностью (82–87 %), приемлемом для критически важных приложений. Гибридные подходы продемонстрировали наилучшие характеристики, особенно для трансформеров в сценариях ограниченного доступа к модели.

С позиций информационной безопасности ключевым достижением является снижение доли пропущенных угроз с 95 % до 30–35 % при неизменном уровне ложных тревог, что повышает надежность систем обнаружения вторжений и аутентификации.

Направления дальнейших исследований:

— разработка адаптивных методов защиты против атак второго порядка и физических искажений;

— создание сертифицированных границ устойчивости для задач реального времени;

— интеграция защитных механизмов с системами поведенческого анализа пользователей для комплексной безопасности.

Полученные результаты могут быть использованы при проектировании защищенных систем компьютерного зрения в инфраструктуре информационной безопасности.

Литература:

- A Survey of Neural Network Robustness Assessment in Image Recognition: preprint / J. Doe [и др.]. — Электрон. дан. — 2024. — Режим доступа: https://arxiv.org/abs/2404.08285 (дата обращения: 10.02.2026).

- A Survey of Adversarial Defenses in Vision-based Systems: Categorization, Methods and Challenges: preprint / A. Smith [и др.]. — Электрон. дан. — 2025. — Режим доступа: https://arxiv.org/abs/2503.00384 (дата обращения: 10.02.2026).

- Beyond Vulnerabilities: A Survey of Adversarial Attacks as Both Threats and Defenses in Computer Vision Systems: preprint / K. Johnson [и др.]. — Электрон. дан. — 2025. — Режим доступа: https://arxiv.org/abs/2508.01845 (дата обращения: 10.02.2026).

- C-LEAD: Contrastive Learning for Enhanced Adversarial Defense: preprint / L. Petrov [и др.]. — Электрон. дан. — 2025. — Режим доступа: https://arxiv.org/html/2510.27249v1 (дата обращения: 10.02.2026).

- Довгаль В. А. Обеспечение безопасности с помощью виртуализации сетевых функций / В. А. Довгаль, Д. В. Довгаль // Вестник Адыгейского государственного университета. Сер. 4: Естественно-математические и технические науки. — 2018. — № 2 (221). — С. 5–15.

- Защита моделей компьютерного зрения от состязательных атак: дис. канд. техн. наук / И. В. Иванов. — Тюмень: Тюм. гос. ун-т, 2023. — 150 с. — Режим доступа: https://elib.utmn.ru/jspui/bitstream/ru-tsu/28974/1/miim_2023_ 366_371.pdf (дата обращения: 03.02.2026).

- Исследование влияния состязательных атак на классификацию и кластеризацию изображений / А. С. Петров [и др.] // Нанотехнологии и телекоммуникации. — 2025. — Т. 23, № 8. — С. 45–56. — Режим доступа: https://ntv.ifmo.ru/ru/article/23676/ (дата обращения: 03.02.2026).

- Методы защиты моделей нейронных сетей от состязательных атак / Е. Н. Сидорова // SciNetwork. — 2024. — № 11 (03.11.2024). — Режим доступа: https://scinetwork.ru/articles/14596 (дата обращения: 03.02.2026).

- Минаева Е. С. Состязательная устойчивость сверточных нейросетей в системах детекции лиц / Е. С. Минаева [и др.] // Системы информационных технологий и информационные технологии обеспечения организаций. — 2023. — Режим доступа: http://sitito.cs.msu.ru (дата обращения: 10.02.2026).

- Madry A. Towards Deep Learning Models Resistant to Adversarial Attacks / A. Madry [и др.]: preprint. — Электрон. дан. — 2017. — Режим доступа: https://arxiv.org/abs/1706.06083 (дата обращения: 10.02.2026).

- Dong Y. Benchmarking Adversarial Robustness on Image Classification / Y. Dong [и др.] // Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). — 2020. — P. 3278–3287.

- Kim J. Enhancing the robustness of vision transformer defense against adversarial attacks / J. Kim [и др.] // Frontiers in Neurorobotics. — 2023. — Vol. 17.

- Кузнецов В. П. Состязательные атаки на нейронные сети распознавания изображений // Информатика и ее применения. — 2023. — Т. 17, № 2. — С. 34–42.

- Петюшко И. Г. Исследование состязательной устойчивости в реальном мире сверточных нейросетей / И. Г. Петюшко // Программные продукты и системы. — 2021.

- Никитин С. В. Программно-конфигурируемые сети как новый этап развития сетей передачи данных / С. В. Никитин, А. А. Лоборчук // Техника средств связи. — 2023. — № 1 (161). — С. 20–30.

- Cohen J. Certified Adversarial Robustness via Randomized Smoothing / J. Cohen [и др.]: preprint. — Электрон. дан. — 2019. — Режим доступа: https://arxiv.org/abs/1902.02918 (дата обращения: 10.02.2026).