В статье рассматриваются перспективы внедрения искусственного интеллекта в систему судопроизводства Российской Федерации. Проведен анализ международного опыта использования ИИ в судебной практике, включая примеры из США, Китая, Эстонии, Франции и Австралии. Особое внимание уделено вопросам обеспечения доверия к технологиям ИИ в судопроизводстве, таким как прозрачность и объяснимость алгоритмов, соблюдение правовых и этических стандартов, кибербезопасность и защита данных, подготовка кадров и открытый диалог с общественностью. Делается вывод о необходимости ответственного и постепенного внедрения ИИ в российскую судебную систему с учетом международного опыта и национальных особенностей, что позволит повысить эффективность правосудия и укрепить доверие общества к судебной системе.

Ключевые слова : искусственный интеллект, судопроизводство, кибербезопасность.

Искусственный интеллект (ИИ) становится одной из ключевых технологий, трансформирующих современное общество. Его применение охватывает множество сфер, включая медицину, образование, промышленность и государственное управление. В сфере судопроизводства ИИ обладает потенциалом для повышения эффективности, прозрачности и доступности правосудия. Однако в Российской Федерации применение ИИ в судебной системе находится на начальных этапах развития и требует тщательного анализа и осмысления.

Стратегическое направление развития ИИ в России определяется Указом Президента Российской Федерации от 10 октября 2019 года № 490 «О развитии искусственного интеллекта в Российской Федерации» (с изменениями на 15 февраля 2024 года) [1], который устанавливает приоритеты государства в этой области и подчёркивает необходимость интеграции ИИ в различные отрасли, включая потенциально правовую систему. В рамках указа был инициирован федеральный проект «Искусственный интеллект», направленный на создание условий для использования отечественных ИИ-технологий в экономике, социальной сфере и государственном управлении. С 1 сентября 2024 года руководство этим проектом переходит от Министерства экономического развития к Министерству цифрового развития, связи и массовых коммуникаций Российской Федерации [2], что призвано усилить координацию и ускорить внедрение ИИ-технологий в ключевые отрасли, включая возможное применение в судопроизводстве.

В то время как в России применение ИИ в судебной системе только начинает обсуждаться, в ряде зарубежных стран ИИ уже активно используется для поддержки судебных процессов. Примеры международного опыта демонстрируют разнообразие подходов к интеграции ИИ в судопроизводство (Таблица 1).

Таблица 1

Примеры международного применения ИИ в судопроизводстве

|

Страна Название системы/ проекта |

Особенности |

Преимущества |

Недостатки |

Объём использования |

Регулирующие положения |

|

США COMPAS |

Система оценки риска рецидива преступников с помощью ИИ |

Помощь судьям в принятии решений о мерах пресечения и условиях освобождения |

Критика за возможную предвзятость по расовому признаку, непрозрачность алгоритма [3] |

Используется в некоторых штатах |

Нет единого федерального регулирования; применение зависит от штата |

|

Китай Интернет-суды |

Использование ИИ для рассмотрения дел, связанных с электронной коммерцией и интернет-правонарушениями |

Ускорение процессов, доступность правосудия, онлайн-заседания [4] |

Вопросы прозрачности и справедливости процессов, контроль со стороны государства |

Три интернет-суда (Ханчжоу, Пекин, Гуанчжоу); рассмотрены тысячи дел |

Государственное регулирование и нормативы по применению ИИ в судах |

|

Эстония «Робот-судья» |

Автоматизация рассмотрения мелких гражданских споров (иски до 7 000 евро) с использованием ИИ [5] |

Разгрузка судов, ускорение рассмотрения дел |

Правовые вопросы ответственности ИИ, ограничения по типам дел |

Пилотный проект, ограниченное применение |

Планируется законодательное регулирование использования ИИ в судах |

|

Франция Predictice |

Анализ судебной практики для прогнозирования исхода дел |

Повышение эффективности работы юристов, информирование стратегии ведения дел [6] |

Возможная предвзятость, зависимость от качества данных, правовые ограничения на прогнозирование поведения судей |

Используется юридическими фирмами и адвокатами |

Законодательные ограничения на использование данных о судьях |

|

Австралия Онлайн-медиация |

Использование ИИ (чат-ботов) для разрешения потребительских и коммерческих споров без обращения в суд [7] |

Снижение нагрузки на суды, ускорение урегулирования споров |

Ограничения в сложности дел, вопросы конфиденциальности |

Применяется в ряде регионов |

Местные законодательные акты, регулирующие онлайн-разрешение споров |

Эти примеры демонстрируют потенциал ИИ, включая автоматизацию рутинных процессов, анализ больших объёмов данных и повышение доступности правосудия для граждан. Однако они также указывают на ряд вызовов и рисков, связанных с внедрением ИИ. Ключевые из них включают юридические аспекты (обеспечение конфиденциальности данных, защита персональной информации, соблюдение принципа справедливости) и этические вопросы (ответственность за решения, принимаемые с использованием ИИ, возможные предубеждения алгоритмов).

В российском контексте необходимо учитывать эти международные уроки при разработке и внедрении ИИ в судебную систему. Это требует разработки нормативно-правовой базы, обеспечивающей регулирование использования ИИ, а также проведения пилотных проектов и исследований, направленных на адаптацию технологий к российским реалиям.

Обеспечение доверия к технологиям искусственного интеллекта в судопроизводстве

Прозрачность и объяснимость алгоритмов

Одним из основных условий формирования доверия к ИИ является прозрачность и объяснимость алгоритмов, используемых в судебных процессах. Традиционные модели машинного обучения, особенно глубокие нейронные сети, часто рассматриваются как «чёрные ящики» из-за сложности их внутренних механизмов. Это вызывает опасения относительно возможности понять и объяснить решения, принимаемые такими системами.

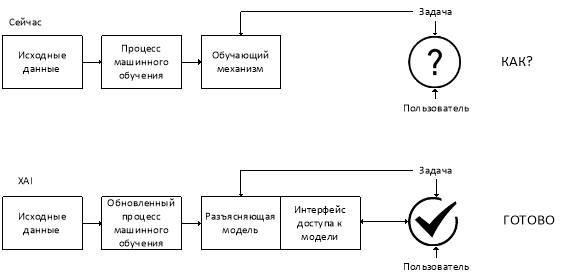

Для решения этой проблемы в научном сообществе активно разрабатываются методы интерпретируемого и объяснимого искусственного интеллекта (Explainable AI, XAI, Руснок 1). Эти методы позволяют создавать модели, решения которых могут быть проанализированы и поняты человеком [8]. Например, использование решающих деревьев, линейных моделей или методов на основе правил обеспечивает высокую степень интерпретируемости. Кроме того, техники пост-хок объяснения, такие как LIME (Local Interpretable Model-agnostic Explanations) и SHAP (SHapley Additive exPlanations), позволяют интерпретировать результаты сложных моделей, предоставляя локальные объяснения для конкретных решений.

Рис. 1. Explainable AI, XAI

Прозрачность также включает в себя открытость информации о данных, используемых для обучения моделей ИИ. Это позволяет оценить качество и репрезентативность данных, выявить возможные источники предвзятости и обеспечить соответствие нормативным требованиям. В судебной сфере использование открытых и проверяемых наборов данных способствует повышению доверия к результатам, полученным с помощью ИИ.

Соблюдение правовых и этических стандартов

Системы ИИ в судопроизводстве должны строго соответствовать действующим правовым нормам и этическим принципам. Это включает в себя соблюдение принципов верховенства права, прав человека и основных свобод. В частности, необходимо обеспечить недопустимость дискриминации и предвзятости при принятии решений.

Алгоритмическая предвзятость может возникать по разным причинам: из-за исторической предвзятости данных, особенностей алгоритма или некорректной постановки задачи [9]. Для её предотвращения используются различные методы, включая предварительную обработку данных для устранения предвзятости.

Нельзя допустить последствий игнорирования этих вопросов, чтобы системы искусственного интеллекта, как в случае с Amazon, не повторяли ошибок. Разработанная компанией система для отбора кандидатов, обученная на исторических данных, начала проявлять дискриминацию по отношению к женщинам-кандидатам, что в итоге вынудило компанию отказаться от её использования. Это произошло из-за того, что алгоритм обучался на данных о сотрудниках компании за последние десять лет, где большинство составляли мужчины. Такой перекос в обучающей выборке привел к тому, что искусственный интеллект стал считать кандидатов-мужчин более предпочтительными.

Эти случаи подчеркивают важность создания стандартов и руководств, направленных на предотвращение предвзятости. Например, Европейская комиссия предложила «Акт об искусственном интеллекте» (Artificial Intelligence Act), который устанавливает гармонизированные правила использования ИИ в Евросоюзе, включая требования к прозрачности, безопасности и соблюдению фундаментальных прав [9]. Эти инициативы могут служить моделью для разработки аналогичных нормативных актов в России.

Однако соблюдение правовых стандартов — лишь одна сторона вопроса. Для того чтобы системы ИИ вызывали доверие, необходимо уделять особое внимание кибербезопасности.

Обеспечение кибербезопасности и защиты данных является критически важным для формирования доверия к ИИ в судебной системе. Судебные процессы связаны с обработкой конфиденциальной информации, включая персональные данные, коммерческую тайну и другие чувствительные сведения. Несанкционированный доступ или утечка данных могут не только нанести вред участникам процесса, но и подорвать доверие к системе правосудия в целом.

Для предотвращения подобных рисков необходимо внедрять комплексные меры кибербезопасности:

– Технические меры : использование современных средств защиты информации, включая шифрование данных, защиту от несанкционированного доступа, мониторинг и обнаружение вторжений.

– Организационные меры : разработка и внедрение политик безопасности, регулярное обучение персонала, проведение аудитов и оценок рисков.

– Соответствие законодательству : соблюдение требований национальных и международных нормативных актов в области защиты персональных данных, таких как Федеральный закон № 152-ФЗ «О персональных данных» в России.

Кроме того, следует учитывать новые угрозы, связанные с применением ИИ, такие как атаки на обучающие данные (data poisoning) и уязвимости в алгоритмах. Для их предотвращения требуется проведение регулярного тестирования систем на устойчивость к кибератакам и использование методов защищённого машинного обучения.

Интеграция средств защиты данных в архитектуру ИИ должна начинаться на этапе проектирования (подход «privacy by design») и включать такие механизмы, как минимизация обработки данных, использование анонимизации и псевдонимизации. Также важно учитывать, что современные судебные системы всё чаще используют облачные технологии для хранения данных, что требует строгого контроля над соблюдением конфиденциальности и защищённости информации в облачных средах.

Подготовка кадров и повышение осведомлённости

Ключевым фактором успешного внедрения ИИ в судопроизводство является подготовка квалифицированных кадров, способных работать с новыми технологиями и понимать их влияние на юридические процессы. Судьи, прокуроры, адвокаты и другие участники судебной системы должны иметь базовые знания в области ИИ и цифровых технологий [11].

Образовательные учреждения могут внести значительный вклад, включив в учебные программы дисциплины, посвящённые ИИ в праве, кибербезопасности и цифровой трансформации судебной системы. Профессиональные тренинги и семинары для действующих специалистов также способствуют повышению компетентности и осведомлённости.

Кроме того, важно развивать междисциплинарные связи между юристами и специалистами в области ИТ, чтобы обеспечить эффективное взаимодействие и взаимопонимание при разработке и внедрении ИИ-систем.

Прозрачность и участие общественности в процессе внедрения ИИ в судопроизводство способствуют повышению доверия и легитимности технологий. Открытый диалог позволяет учесть мнения и опасения различных групп, а также обеспечить информированность общества о целях, преимуществах и рисках использования ИИ.

В нормативно-правовой базе следует предусмотреть механизмы ответственности за нарушения при использовании ИИ. Это может включать в себя определение юридической ответственности разработчиков, поставщиков и пользователей ИИ-систем, а также установление санкций за несоблюдение требований.

Постепенное внедрение ИИ в судопроизводство через реализацию пилотных проектов позволяет минимизировать риски и накопить практический опыт. Пилотные проекты могут быть реализованы в отдельных регионах или сферах права, что позволит протестировать технологии в реальных условиях.

Для успешной реализации всех этих мер важно поэтапное внедрение ИИ в судопроизводство. При реализации пилотных проектов важно:

– Оценивать эффективность и безопасность: проводить регулярные анализы результатов, выявлять проблемы и вносить коррективы.

– Обеспечивать прозрачность: информировать общественность о целях, методах и результатах проектов.

– Собирать обратную связь: учитывать мнение пользователей и участников процесса для улучшения систем.

Кроме того, обмен опытом с другими странами и участие в международных инициативах по регулированию и развитию ИИ в судопроизводстве способствуют повышению компетентности и внедрению лучших практик. Это может включать участие в международных организациях, совместные исследования и проекты, а также изучение успешных кейсов внедрения ИИ в судебных системах других государств.

Заключение

Внедрение искусственного интеллекта в судопроизводство России обладает значительным потенциалом для повышения эффективности и доступности правосудия. Международный опыт показывает, что ИИ может успешно использоваться в судебной сфере, но требует осторожного и ответственного подхода. Ключевыми факторами являются обеспечение прозрачности и объяснимости алгоритмов, соблюдение правовых и этических стандартов, а также кибербезопасность и защита данных. Подготовка квалифицированных кадров и открытый диалог с обществом способствуют формированию доверия к новым технологиям. При условии внимательного учета этих аспектов и постепенного внедрения через пилотные проекты, искусственный интеллект может стать эффективным инструментом модернизации российской судебной системы, укрепляя принципы справедливости и верховенства закона.

Литература:

- Указ Президента Российской Федерации от 10 октября 2019 года № 490 «О развитии искусственного интеллекта в Российской Федерации» (с изменениями на 15 февраля 2024 года).

- ТАСС. Передача федерального проекта «Искусственный интеллект» Минцифры должна ускорить внедрение ИИ [Электронный ресурс] // Официальный интернет-ресурс Министерства цифрового развития, связи и массовых коммуникаций Российской Федерации. 2024. 2 августа.

- Angwin J., Larson J., Mattu S., Kirchner L. Machine Bias [Электронный ресурс] // ProPublica. 2016. URL: https://www.propublica.org/article/machine-bias-risk-assessments-in-criminal-sentencing (дата обращения: 16.11.2024).

- Liu H. Smart Courts and Artificial Intelligence in China // International Journal of Law and Technology. 2023. Vol. 15, No. 1. P. 25–38.

- Välimets M. AI Judge: The Estonian Approach to Digital Justice // Baltic Legal Review. 2023. No. 4. P. 50–60.

- Aletras N., Tsarapatsanis D., Preoţiuc-Pietro D., Lampos V. Predicting Judicial Decisions of the European Court of Human Rights: A Natural Language Processing Perspective // PeerJ Computer Science. 2016. Vol. 2. Article e93.

- Tyler M. Artificial Intelligence in Online Dispute Resolution: The Australian Experience // Journal of Dispute Resolution. 2023. No. 2. P. 89–102.

- Doshi-Velez F., Kim B. Towards A Rigorous Science of Interpretable Machine Learning [Электронный ресурс] // arXiv preprint. 2017. URL: https://arxiv.org/abs/1702.08608 (дата обращения: 16.11.2024).

- European Commission. Proposal for a Regulation Laying Down Harmonised Rules on Artificial Intelligence (Artificial Intelligence Act). Brussels, 2021.

- Абрамов В. П. Кибербезопасность и защита данных при использовании искусственного интеллекта в правовой сфере // Юридический вестник. 2022. Т. 5, № 2. С. 112–118.

- Иванов А. Н. Подготовка юридических кадров в эпоху цифровизации: вызовы и перспективы // Право и образование. 2023. № 2. С. 45–53.