Рассмотрены основные алгоритмы, благодаря которым проводят проверку уникальности ведущие поисковые системы и программы. Перечислены основные задачи интернет-продвижения.

Ключевые слова: шинглы, перцептивный хэш, SEO, SEO-копирайтинг, SMM, SMO.

На текущий момент времени все большую и большую популярность получает продвижение товаров и услуг с помощью интернета. Для продвижения продукта или услуги в социальных сетях, как правило, используют следующие мероприятия: SEO (search engine optimization), SMM (social media marketing), SMO (social media optimization), CPA (cost per action) и др.

Актуальность SEO (поисковой оптимизации) состоит в том, что с каждым годом увеличивается доля интернет-коммерции, а продвижение сайтов в поисковых системах получает большее распространение и популярность [1]. В то же время комплекс работ по SEO сравнительно недорого стоит и имеет высокую эффективность, в отличие от стандартной рекламы. Основные принципы SEO:

- Успешный сайт, привлекающий внимание покупателей, выполняющий свои основные задачи [2];

- Сайт находится в зоне видимости по всем необходимым запросам;

- На сайте публикуется только уникальный контент: как текст, так и изображения;

- Ведется оптимизация кода;

- Проводятся грамотные работы по внешней оптимизации;

- Ведется непрерывная работа с поведенческими факторами.

Основные задачи SMM (продвижения в социальных сетях) состоят не только в том, чтобы увеличить долю доверия к товару или услуги, но еще и продавать услугу или товар с помощью социальных сетей. Социальные сообщества могут получать новых клиентов не только внутри сети, но еще и посредством поискового трафика. К основным принципам SMM можно отнести:

- Публикация только качественного контента;

- Размещение рекламы эффективно;

- Прямое взаимодействие с целевой аудиторией;

- Расширение партнерской сети (поиск новых партнеров в социальных сетях);

- Постоянное развитие [3].

Из общих принципов продвижения в интернете видно, что уникализация контента играет одну из ключевых ролей. Существуют различные способы уникализации изображений и текстов. В основном алгоритмы уникализации строятся на математически алгоритмах, которые в дальнейшем используют поисковые машины для правильного ранжирования web-страниц.

Уникализация изображений.

Достаточно часто для уникализации изображений на сайте или в социальном сообществе используется алгоритм перцептивный хэш.

Перцептивные хэш-алгоритмы предназначены для описания классов функций для генерации сравнимых хэшей. Основные характеристики изображения могут использоваться для генерации индивидуального отпечатки, затем эти отпечатки сравнивают между собой.

Основное отличие перцептивного хэша от стандартных криптографических функций вида MD5 и SHA1 состоит в том, что при сравнении можно сделать вывод о степени различия наборов данных. В то время, как сравнение двух хэш-кодов в функциях вида SHA1 можно делить только на два вида:

Если хэш-коды отличаются друг от друга, данные разные

Если хэш-коды совпадают, скорее всего, данные одинаковые (однако, есть вероятность коллизий, поэтому одинаковые хэши не являются гарантом одинаковых данных).

Алгоритмы вычисления перцептивного хэша имеют базовые свойства:

- Картинку можно изменять в размере

- Края изображения могут быть обрезаны.

- Можно менять цветовые характеристики (яркость или контраст).

Однако после этих процедура данные совпадают по хэшу.

Алгоритмы поисковых машин вычисляют уникальность (несовпадения) изображений по следующему алгоритму:

- Первым действием является уменьшение размера. Как правило, картинка сжимается до размера 8х8, общее число пикселей в таком изображении составляет 64. Таким образом, хэш соответствует различным вариантам изображения, независимо от размера.

- Следующий шаг — обесцвечивание изображения. Данная маленькая картинка переводится в градации серого, так, что хэш уменьшает значение с 64 пикселей до 64 значений цвета.

- После этого поисковая машина начинает искать среднее. Вычисляет среднее значение для 64 цветов.

- Следующий этап — построение цепочки битов. В данной ситуации для каждого цвета идет присваивание 0 или 1, в зависимости от того, какое получили значение на предыдущем шаге: больше или меньше среднего.

- Заключительный этап заключается в простроении хэша. Переводится 64 отдельных бита в одно 64-битное значение. Порядок сохраняется [4].

Исходя из этой информации, можно сделать вывод:

Если изображение при проверке на уникальность обрезается и обесцвечивается, то мало просто изменить цвет картинки или нарисовать рамку для ее уникализации. Главный шаг для того, чтобы изменить финальный хэш изображения — сдвиг на несколько градусов. При повороте изображения, его сжатие будет давать совсем другую картину сжатых пикселей. А значит, начиная с первого шага проверки, изображение будет уже совсем новым. Такой алгоритм также называют «финт Зидана». Математически это можно представить следующим образом:

Имеем m-канальное n-мерное изображение:

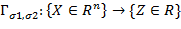

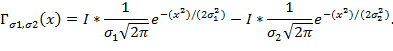

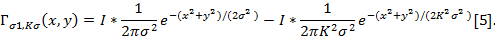

Применяем DoG-фильтр (difference of Gaussians) для изображения I с помощью функций:

Полученное в результате вычитания изображения I из Гауссовской дисперсии  от образа I, сжатого с меньшей дисперсией

от образа I, сжатого с меньшей дисперсией  c

c .

.

И центрирование в случае двумерного изображения:

Уникализация текста.

Самым главным способом уникализации текста является копирайтинг. Копирайтинг — создание текста, который будет носить рекламный или презентационный характер. Часто данные тексты выкладываются на страницах web-сайтов и в коммерческих социальных сообществах. Одна из отличительных особенностей таких текстов: уникальность. Существует такая разновидность копирайтинга — SEO-копирайтинг. Он применяется не только на сайтах, но и в социальных сообществах в разрезе SMO (social media optimization). SEO-копирайтинг отличается от обычного копирайтинга лишь тем, что в тексте должно присутствовать указанное количество ключевых слов. Ключевые слова — те слова, по которым ведется продвижение товара или услуги в интернете. Таким образом, можно сформулировать основные задачи SEO-копирайтинга:

- Продвижение сайта или социального сообщества в поисковых системах с помощью ключевых слов:

- Корректное и удобное представление информации для пользователей на текущем web-ресурсе;

- Качественное маркетинговое описание товара или услуги.

Однако, алгоритмы поисковых систем регулярно проверяют тексты на уникальность. Благодаря такой проверке web-ресурсы с уникальными изображениями и текстами поднимаются в поиске выше, а страницы с ворованным контентом опускаются или вовсе блокируются. Самые распространенные алгоритмы проверки на уникальность: шингловые и нешингловые (корреляционные).

Шингловые алгоритмы подразумевают под собой взятие за основу выявленных совпадений текстовых объектов, а именно:

Удаление из текста стоп-слов, а именно: союзов, предлогов, частиц, междометий, метоимений, вводных слов, которые не несут смысловой нагрузки;

Оставшийся текст делится на фрагменты заданной длины. Эти фрагменты будут именоваться шинглами.

Затем идет сравнение по хэш-функции слов, которые имеются в тексте с web-ресурсами.

В конечном итоге получаем общую уникальность, а также фразы, которые являются неуникальными.

Корреляционные алгоритмы проверяют тексты по наличию синонимов, перестановки слов в предложении. Проверка с помощью такого алгоритма происходит следующим образом:

- Текст разделяется на несколько частей.

- Для каждого слова в определенной части высчитывается его «вес» — частота использования.

- Слова, имеющие наибольший «вес» участвуют в проверке.

- Если в процессе поиска найдет web-ресурс со словами, которые сходятся по данному параметру, текст считается плагиатом.

Заключение:

Рассмотрев основные алгоритмы с математической точки зрения можно рассчитать итоговую вероятность уникальности своей страницы без применения специального программного обеспечения. Однако, текущие алгоритмы имеют ряд недостатков, одним из них является относительно высокая надежность. Полностью раскрыв алгоритмы проверки текстовой информации, можно варьировать релевантностью на просторах сети.

Информация о проверке на уникальность пригодилась бы многим, кто работает в сфере интернет-продвижения. Знания о данных алгоритмах могут намного упростить процесс продвижения, сделав его более профессиональным, качественным, эффективным, не увеличивая при этом затраты на работу. Помимо этого можно улучшить и усовершенствовать текущие алгоритмы поиска, в частности участвую в конкурсах, проводимых компаниями «Яндекс» и «Google».

Литература:

1. Крутько Е. А., Методы поисковой оптимизации (SEO) // Крутько Е. А., Битюцкая Н. И., XXII студенческая международная научно-практическая конференция

2. Ашманов И. С., Оптимизация и продвижение сайта в поисковых системах // Ашманов И. С., Иванов А. Б., Питер — 2008 г., с.44

3. Сенаторов А., Битва за подписчиков «Вконтакте». SMM-руководство, Альпина Паблишер — 2014 г., с.27

4. Статья о перцептивном хэше [Электронный ресурс] — URL:http://habrahabr.ru/post/65944/

5. «Molecular Expressions Microscopy Primer: Digital Image Processing — Difference of Gaussians Edge Enhancement Algorithm», Olympus America Inc., and Florida State University Michael W. Davidson, Mortimer Abramowitz